HiSilicon AI SoCs fordern heraus, wie wir Video analysen sehen

HiSilicon AI-SoCs beschleunigen die Video analyze mithilfe einer dedizierten Neural Processing Unit (NPU). Dieser spezial isierte Chip wird gebaut

HiSilicon AI-SoCs beschleunigen die Video analyze mithilfe einer dedizierten Neural Processing Unit (NPU). Dieser spezial isierte Chip wurde für künstliche Intelligenz entwickelt und bietet leistungs starke KI-Funktionen direkt für Edge-Computing-Geräte für eine bessere KI-Leistung. Die NPU erledigt komplexe KI-Aufgaben wie die Objekter kennung viel schneller als eine Standard-CPU und ermöglicht eine effektive Echtzeit verarbeitung.

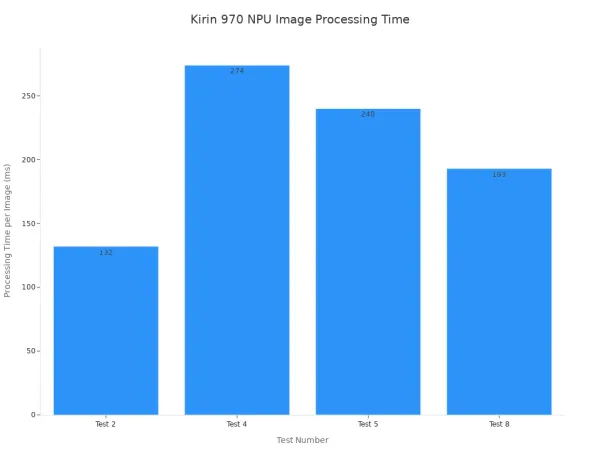

Diese künstliche Intelligenz auf dem Gerät ist entscheidend für die Edge-KI, bei der eine sofortige Datenanalyse für ein erfolgreiches Edge-Computing erforderlich ist. Die Leistungs steigerungen sind signifikant, wie in Bild verarbeitung tests gezeigt.

Dieser Ansatz für Edge Computing gewähr leistet eine schnelle Video analyze und unterstützt die anspruchs volle Echtzeit verarbeitung komplexer KI-Modelle.

Wichtige Imbiss buden

- HiSilicon AI SoCsVerwenden Sie spezielle Chips, die als NPUs bezeichnet werden. Diese NPUs machen KI-Aufgaben wie Video analyze auf Geräten viel schneller.

- Diese ChipsHaben ein spezielles Design. Dieses Design hilft ihnen, viele Aufgaben auf einmal zu verarbeiten. Dies macht eine Video analyze in Echtzeit reibungslos und schnell.

- Die Chips bereiten Videodaten vor, bevor KI sie sieht. Dadurch wird die KI-Analyse genauer. Sie behandeln auch die Video kom primi erung effizient.

- HiSilicon-SoCs verwenden gemeinsamErinnerung. Dies hilft Daten schnell zwischen verschiedenen Teilen des Chips zu bewegen. Dadurch laufen KI-Anwendungen sehr schnell.

- Diese Chips helfen Geräten, sofort intelligente Entscheidungen zu treffen. Das ist wichtig für Dinge wie selbst fahrende Autos. Sie halten auch Ihre Daten sicher und privat.

WIE HISILICON AI SOCS KI BESCHLEUNIGEN:

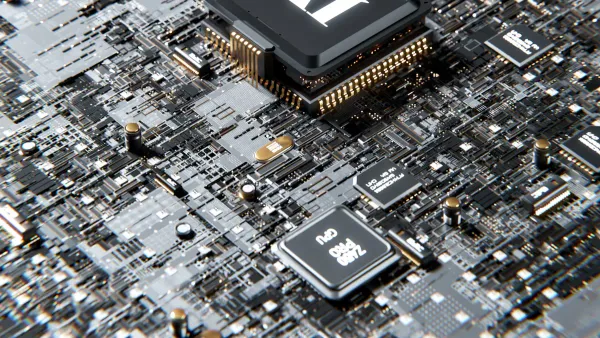

HiSilicon AI-SoCs verwenden spezielle Hardware, um Aufgaben der künstlichen Intelligenz zu beschleunigen. Dieses Design ist der Schlüssel für effektives Edge Computing. Die Chips führen komplexe Berechnungen für Video analysen viel schneller durch als Allzweck prozessoren. Diese Funktion ermöglicht eine leistungs starke Echtzeit verarbeitung direkt auf Geräten.

DIE MACHT DER NPU:

Die Neuronale Verarbeitung einheit (NPU) ist das Gehirn hinter der KI-Beschleunigung. Es fungiert als dedizierter KI-Beschleuniger chip. HiSilicon AI SoCs integrieren leistungs starke AI-Core-Chips, bekannt alsDa Vinci KI-Kerne. Diese Kerne sind die Grundlage für die Leistung der NPU bei der KI-Verarbeitung. Sie sind unerlässlich für Anwendungen, die von Smartphones bis zur nächsten Generation der KI-Automobil prozessor technologie für autonome Fahrzeuge reichen.

- Da Vinci KI-Kerne: Diese Einheiten enthalten eine Skalar komponente für einfache Aufgaben und eine große Vektor einheit für komplexe KI-Mathematik. Sie unterstützen verschiedene Datentypen für die flexible KI-Modell ausführung.

- 3D Cube Engine: Diese Engine zeichnet sich durch Matrix-Mathe aus, die für künstliche Intelligenz von grundlegender Bedeutung ist. Es kann Tausende von Operationen pro Taktzyakt ausführen und so eine schnelle Inferenz für KI-Modelle ermöglichen.

Diese spezial isierte Hardware macht die NPU für KI-Workloads äußerst effizient. Es ermöglicht Geräten, anspruchs volle KI zu betreiben, ohne sich auf die Cloud zu verlassen.

MASSIVE PARALLEL VERARBEITUNG:

Die Architektur dieser SoCs unterstützt eine massive parallele Verarbeitung. Dies bedeutet, dass der Chip viele Aufgaben gleichzeitig bewältigen kann. Ein Hochgeschwindigkeits-Mesh-Netzwerk-on-Chip (NoC) verbindet alle Da Vinci-KI-Kerne. Dieses Netzwerk ermöglicht es Daten, sich schnell zwischen den Kernen und dem Speicher zu bewegen.

Anmerkung:Diese parallele Struktur ist entscheidend für die Echtzeit verarbeitung in der Video analyze. Es ermöglicht einem autonomen System, mehrere Videostreams oder komplexe Szenen gleichzeitig zu analysieren, wodurch Edge Computing leistungs fähiger und reaktions fähiger wird.

Dieses Design minimiert Engpässe und stellt sicher, dass die KI-Kerne immer mit Daten gefüttert werden. Das Ergebnis ist eine reibungslose, kontinuierliche Leistung für anspruchs volle KI-Anwendungen. Dies macht autonome Operationen in Edge-Computing-Umgebungen zu einer praktischen Realität.

ARCHITEKTUR FÜR GESCHWINDIGKEIT GEBAUT:

Eine leistungs starke NPU benötigt ein Support-System, das Daten schnell und effizient bewegt. HiSilicon-SoCs erreichen diese Geschwindigkeit durch eine eng integrierte Architektur. Jede Komponente arbeitet zusammen, um Engpässe zu beseitigen, ein Design, das für anspruchs volleAiAufgaben inKanten-Computing. Dieser Systema nsatz sorgt für eine reibungslose, schnelle Leistung fürEchtzeit verarbeitung.

INTEGRIERTER ISP FÜR BILD PRE-PROCESSING:

Bevor die NPU ein Bild analysieren kann, werden die Rohdaten einer KameraSensorBraucht Vorbereitung. Das ist die Aufgabe derIntegrierter Bildsignal prozessor (ISP). Der ISP wirkt wie eine digitale Dunkelkammer und reinigt und verbessert den Videostream, bevor er dieAiKern. Dieser Schritt ist entscheidend für die genaueAiAnalyse.

DieHi-ISP-Video verarbeitung maschineBehandelt mehrere Schlüssel aufgaben, um einen sauberen Datenstrom für die NPU zu erstellen:

- Breiter dynamischer Bereich (WDR): Es gleicht sehr helle und sehr dunkle Bereiche in einer Szene aus, um sicher zustellen, dass keine Details in Schatten oder Highlights verloren gehen.

- Geräusch reduzierung: Der Motor entfernt Seh geräusche, insbesondere bei schlechten Licht verhältnissen, was verwirren kannAiModelle.

- Bild korrektur: Es kann Linsen verzerrungen wie den Fisch augen effekt korrigieren oder Umgebungs dunst mit seiner Ent nebel funktion entfernen.

Tipp:Die Optimierung der ISP-Funktionen kann sich dramatisch verbessernAiLeistung. Studien zeigen, dass die richtige ISP-AbstimmungErhöhen Sie die Genauigkeit der Objekter kennung um bis zu 30%. Durch einfaches Aktivieren einer Funktion wie dem Tone Mapping kann die Modell genauigkeit um 5,8% gesteigert werden.

Diese Vor verarbeitung füttert die NPU ein qualitativ hochwertiges, optimiertes Bild. Die NPU arbeitet dann mit klaren Daten, was zu einer zuverlässige ren und präziserenAiErgebnisse.

DEDIZIERTER VIDEOMOTOR:

Videodaten sind groß und erfordern eine erhebliche Verarbeitung leistung zum Komprimieren (Codieren) und Dekomprimieren (Dekodieren). HiSilicon SoCs verlagern diese schwere Aufgabe auf eine dedizierte Video-Engine. Diese spezielle Hardware übernimmt die Kom primi erung und Dekom primi erung von Videos und gibt CPU und NPU die Möglichkeit, sich auf ihre Haupt funktionen zu konzentrieren. Diese Arbeits teilung ist essenz iell für EffektivitätEchtzeit verarbeitungInKanten-ComputingUmgebungen.

Die Engine unterstützt die neuesten Videos tandards und ermöglicht die effiziente Verwaltung hoch auflösender Streams. Diese Funktion stellt sicher, dass Geräte moderne Videoformate ohne Leistungs verlust verarbeiten können.

| Funktion | Unterstützte Standards | Max Auflösung/FPS |

|---|---|---|

| Video-Dekodierung | AVS3, AVS2/HEVC/AV1 | 8K @ 120 fps |

| Video-Dekodierung | VP9/AVC | 8K @ 60 fps |

| Video kodierung | H.265/H.264 | 4K @ 60 fps |

Indem der SoC dieser Aufgabe Hardware widmet, stellt er diesen Komplex sicherAiAnalysen können neben qualitativ hochwertiger Video codierung und-decodierung ausgeführt werden, ohne um Ressourcen zu konkurrieren.

EINHEITLICHES SPEICHER FÜR NIEDRIGE LATENZ:

Bei Geschwindigkeit geht es nicht nur um Rechen leistung. Es geht auch darum, wie schnell sich Daten zwischen Komponenten bewegen. HiSilicon SoCs verwenden eineEinheitliche Speicher architekturExtrem zu erreichenGeringe Latenz. In herkömmlichen Systemen verfügen CPU, GPU und NPU über separate Speicher pools. Das Verschieben von Daten zwischen ihnen ist langsam und ineffizient.

Unified Memory löst dieses Problem. Es entsteht einEinzelner, gemeinsamer Pool von Hoch geschwindigkeit speicher(WieLPDDR5), Auf die alle Prozessoren auf dem Chip direkt zugreifen können.

- Keine Daten kopieren: ISP, NPU und CPU können alle mit denselben Daten arbeiten, ohne langsame Kopien zu erstellen.

- Kürzere Wege: Durch die Integration des Speichers auf dem Chip wird die physische Entfernung verkürzt, die Daten zurücklegen müssen, wodurch Verzögerungen verringert werden.

- Höhere Bandbreite: Dieses Design ermöglicht breitere und schnellere Wege für Daten und erhöht den Gesamt durchsatz.

Diese Architektur ist ein Game-Changer fürKanten-Computing. Es beseitigt die Daten übertragungs engpässe, die komplexe Workflows verlangsamen können. Das Ergebnis ist ein hoch responsives System, das in der Lage ist, die intensiven Daten anforderungen moderner zu bewältigenAiAnwendungen.

REAL-WORLD-AUSWIRKUNGEN AM RAND:

Die architekto nische Geschwindigkeit von HiSilicon-SoCs schafft erhebliche reale Vorteile für Edge-Computing. Diese Chips bringen leistungs starke künstliche Intelligenz direkt auf Geräte. Diese Fähigkeit verändert Branchen, die auf sofortige Datenanalyse angewiesen sind, insbesondere für autonome Fahrzeuge. Der ai kann Entscheidungen ohne Cloud-Verzögerungen treffen.

ECHTZEIT OBJEKT DETEKTION:

Eine schnelle Echtzeit verarbeitung ist entscheidend für die Sicherheit in autonomen Systemen. Mit HiSilicon-SoCs können autonome Fahrzeuge Objekte sofort identifizieren. Das ai verwendet Daten aus mehrerenSensorenFußgänger, andere Autos und Verkehrs zeichen zu sehen. Diese sofortige Erkennung ermöglicht es dem autonomen Fahrzeug, schnell zu reagieren. Dieses Leistungs niveau beim Edge Computing ist für ein sicheres Selbst fahren von AI unerlässlich. Das ai in autonomen Fahrzeugen verarbeitet diese Informationen zum sofortigen Handeln. Das autonome Fahrzeug hängt von seinen Sensoren ab. Das autonome Fahrzeug braucht diese Geschwindigkeit.

KOMPLEXE ANALYSE VERHALTEN DES GERÄTES:

Diese SoCs erkennen mehr als nur Objekte. Sie unterstützen komplexe ai-Modelle für die Verhaltens analyze direkt auf dem Gerät. Ein autonomes Fahrzeug kann die Absichten eines Fußgängers vorhersagen. Die künstliche Intelligenz bestimmt, ob eine Person auf die Straße treten könnte. Diese Vorhersage kraft ist ein großer Sprung für autonome Technologie und Selbst fahrer. Es macht Vehicle Edge Computing sicherer und zuverlässiger. Das autonome Fahrzeug nutzt seine Sensoren, um Daten zu sammeln. Das autonome Fahrzeug analysiert es dann. Dieses fortschritt liche ai hilft autonomen Fahrzeugen, in komplexen städtischen Umgebungen zu navigieren.

Diese Analyse auf dem Gerät ermöglicht es einem autonomen System, den Kontext zu verstehen. Das ai kann zwischen einem Kind, das einen Ball jagt, und einem Erwachsenen unterscheiden, der darauf wartet, zu überqueren, wodurch autonome Fahrzeuge intelligenter werden.

VERBESSERTE SICHERHEIT UND DATENSCHUTZ:

Die Verarbeitung auf dem Gerät bietet wichtige Sicherheits-und Datenschutz vorteile für Edge Computing. Die SoC-Architektur kümmert sich lokal um Video analysen. Dieses Design hält sensible Daten von der Cloud fern. Es hilft Unternehmen, Datenschutz bestimmungen wie die DSGVO einzuhalten. Das System nutzt Hardware-Level-Sicherheit für den Datenschutz. Diese lokale Verarbeitung gewähr leistet die Echtzeit verarbeitung von Bedrohungen ohne externe Verbindungen.

HiSilicon ist ein wichtiger Akteur auf dem On-Device-Sicherheits markt. Seine Chips bieten eine sichere Grundlage für ai-Anwendungen. Dieser Ansatz ist für Sektoren, die sensible Informationen verarbeiten, von autonomen Fahrzeugen bis hin zu Smart-City-Sensoren, von entscheidender Bedeutung. Dies macht Edge Computing zu einer sichereren Wahl für Video analysen.

HiSilicon AI-SoCs kombinieren eine leistungs starke NPU, spezielle Hardware-Assists und eine einheitliche Speicher architektur. DieseIntegriertes SystemLiefert die Geschwindigkeit und Energie effizienz für komplexe Video analysen im Edge Computing. Das ai-Design konzentriert sich auf die Leistung für die Echtzeit verarbeitung. Dieser Ansatz schafft effiziente künstliche Intelligenz für Edge Computing, wie im Herstellungs prozess zu sehen ist.

| SoC | Herstellungs prozess | Energie effizienz kerne |

|---|---|---|

| HiSilicon Kirin 810 | 7nm (TSMC) | 4x ARM Cortex-A55 |

| HiSilicon Kirin 820e | 7nm (TSMC) | 4x ARM Cortex-A55 |

| Qualcomm Snapdragon 780G 5G | 5nm (Samsung 5LPE mit EUV) | 4x ARM Cortex-A55 |

Dies macht HiSilicon AI SoCs zu einem Game-Changer für ai. Das ai ermöglicht leistungs starke künstliche Intelligenz für Video analytik. Dies ist entscheidend für moderne ai-Anwendungen und die Zukunft des Edge-Computing. Das ai treibt Innovation an.

FAQ

Was unter scheidet eine NPU von einer CPU?

Eine neuronale Verarbeitung einheit (NPU) ist ein spezial isierter Prozessor. Es erledigt Aufgaben der künstlichen Intelligenz sehr schnell. Eine CPU ist einAllgemeiner ProzessorFür viele Jobs. Die NPU gibt einem autonomen System seine schnelle KI-Leistung und macht das autonome Gerät intelligent und reaktions schnell.

Warum ist die Verarbeitung auf dem Gerät wichtig?

Die Verarbeitung auf dem Gerät bietet Geschwindigkeit und Privatsphäre. Die Datenanalyse erfolgt direkt auf dem Gerät. Dies ermöglicht es einem autonomen System, sofortige Entscheidungen zu treffen. Es schützt auch vertrauliche Informationen, indem es sie nicht an die Cloud sendet. Dies ist entscheidend für jede autonome Operation.

Wie helfen diese Chips autonomen Fahrzeugen?

Diese SoCsGeben Sie autonomen Fahrzeugen die Fähigkeit zu sehen und zu denken. Der Chip verarbeitet Sensordaten für das autonome System. Dies ermöglicht eine schnelle Objekter kennung. Das autonome Fahrzeug kann dann sichere, autonome Fahrent scheidungen in Echtzeit treffen. Diese autonome Fähigkeit ist unerlässlich.

Was machen die ISP-und Video-Engine?

Der Bildsignal-Prozessor (ISP) und die Video-Engine unterstützen die NPU. Der ISP bereinigt Roh videos und gibt dem autonomen System eine klare Sicht. Die Video-Engine verwaltet die Video kom primi erung. Diese Teile helfen dem autonomen Haupt prozessor, effizienter zu arbeiten.