Câmera avançada AI na borda em 2025

Sua jornada para a câmera AI de alto desempenho na borda começa com o hardware. Você deve escolher um HiSilicon SoC com um powerf

Sua jornada para a câmera AI de alto desempenho na borda começa com o hardware. Você deve escolher um HiSilicon SoC com um poderoso NPU. Esta escolha é a sua base para o sucesso.

A chave para desbloquear o desempenho máximo da IA é um pipeline de dados sem cópia. Este método eficiente permite que o processador de imagem no SoC alimente o NPU diretamente.

Dominar este processo envolve três ideias centrais. Você deve entender a arquitetura do pipeline, o ajuste inteligente de imagem com inteligência artificial e a otimização do modelo NPU.

Principais Takeaways

- Escolha um HiSilicon SoC com um poderoso NPU. Esta escolha do hardware é importante para a boa câmera AI.

- Crie um pipeline de dados de cópia zero. Isso conecta o ISP e NPU diretamente. Isso faz sua IA correr mais rápido e usar menos energia.

- Ajuste o ISP para o seu modelo AI. Isso significa ajustar as configurações da câmera para ajudar a IA a enxergar melhor, não apenas para os olhos humanos.

- Otimize seu modelo AI para o NPU. Use a quantização INT8 para tornar seu modelo menor e mais rápido. Isso ajuda a funcionar bem em dispositivos de borda.

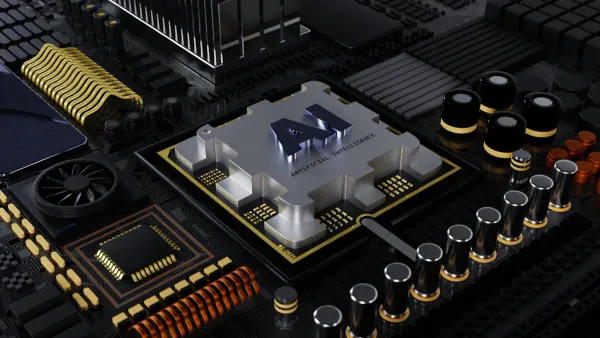

A CÂMERA MODERNA AI PALHA:

Em um SoC móvel moderno, você não está trabalhando com um único processador. Você está conduzindo uma orquestra deAceleradores hardware especializados-A. Entender como essas partes trabalham juntas é crucial para construir um poderoso sistema de IA de câmera na borda. Os dois músicos mais importantes desta orquestra são o Processador de Sinal de Imagem (ISP) e a Unidade de Processamento Neural (NPU).

O PAPEL DO ISP EM PRE-PROCESSING:

Pense no ISP como o assistente inteligente da NPU. Seu trabalho é mais do que apenas fazer fotos parecerem boas. Em um pipeline AI, o ISP atua como um acelerador de hardware para pré-processamento. Ele prepara os dados da imagem perfeitamente para a rede neural. Por exemplo, seu modelo de IA pode precisar de uma imagem pequena de 224x224 pixelsSensorCaptura uma imagem 4K grande.O ISP usa um tubo de saída dedicado para redimensionar a imagem diretamente, Poupando-o de fazer este passo lento no software. Ele também lida com tarefas como converter espaços de cores para corresponder ao que sua rede neural espera.

ARQUITECTURA DA NPU DA VINCI:

A Unidade de Processamento Neural é o cérebro da sua IA.A arquitetura NPU Da Vinci da HiSilicon fornece a força bruta para a inferência IA.Seu design oferece desempenho incrível para cargas complexas AI.

O coração da arquitetura Da Vinci é a sua unidade de computação "Cubo 3D". Este núcleo AI especializado é projetado para acelerar a matemática matricial que forma a base de todos os cálculos de redes neurais.

Essa estrutura exclusiva permite que a NPU execute milhares de operações em um único ciclo de clock.Ele suporta várias precisões de dados, tornando-o flexível para diferentes estágios de desenvolvimento de IA e garantindo inferência eficiente e de baixa potência. Este é o mecanismo que fornece aceleração de hardware para inferência.

A PONTE DE DADOS:

A verdadeira mágica acontece quando o ISP e a NPU trabalham juntos. Eles formam uma ponte de dados direta no SoC, criando um poderoso feedback loop. É assim que funciona:

- A NPU usa seu poder de processamento visual para detectar uma pessoa no quadro.

- Diz ao ISP a localização exata dessa pessoa.

- O ISP ajusta suas próprias configurações, como exposição e foco, nessa área específica para capturar uma imagem muito mais clara da pessoa.

- Essa imagem melhorada é enviada de volta ao NPU para uma análise AI mais precisa.

Essa colaboração estreita aumenta o desempenho geral do sistema e a precisão final da sua IA.

DENTRO DO SOC MÓVEL:

Você tem os principais componentes: oISP e a NPU-A. Agora, você precisa conectá-los dentro do SoC móvel. Esta seção fornece as etapas práticas para criar um pipeline de dados de alto desempenho. Você vai aprender a configurar o hardware, gerenciarMemóriaEficientemente, e ligar os componentes juntos no código. Esse processo é essencial para o aplicativo AI da câmera na borda.

CONFIGURAÇÃO DA PRODUÇÃO ISP:

Seu primeiro passo é dizer ao ISP como preparar os dados de imagem para o seu modelo de IA. Sua rede neural tem necessidades específicas. Por exemplo, pode esperar uma imagem de 224x224 pixels em um formato colorido BGR. É necessário configurar um canal de saída ISP para corresponder exatamente a esses requisitos.

Você pode conseguir isso usando oPlataforma Processo Mídia HiSiliconAPIs (MPP). Aqui está um guia simples:

- Definir atributos do canal: Você cria uma estrutura em seu código para manter as configurações.

- Definir resolução: Você especifica a largura e altura exatas que sua rede neural precisa.

- Definir o formato do pixel: Você escolhe o formato de cor correspondente à camada de entrada do modelo.

- Aplicar configuração: Você chama uma função como

HI_MPI_VI_SetChnAttr()Para aplicar essas configurações a um canal de ISP específico no SoC móvel.

Essa configuração direta descarrega todo o trabalho de pré-processamento no hardware do ISP. O código principal do aplicativo recebe dados que já são perfeitos para inferência de IA.

GESTÃO DE MEMÓRIA EFICIENTE:

O mau gerenciamento da memória pode prejudicar o desempenho do aplicativo. Em um SoC baseado em ARM, você deve lidar com a memória com cuidado para evitar problemas comuns.

- Fragmentação: Alocar e liberar memória pode deixar lacunas pequenas e inutilizáveis. Eventualmente, você não consegue encontrar um bloco grande o suficiente, mesmo com memória livre total suficiente.

- Vazamentos memória: Esquecer a memória alocada livre consome lentamente todos os recursos disponíveis, levando a falhas no sistema.

- Referências perdidas: Ponteiros para a memória podem ser perdidos, tornando impossível liberar a memória mais tarde.

Para evitar esses problemas, você não deve usarAlocação memória dinâmica padrão-A. Em vez disso, você deve alocar memória de um pool de Video Buffer (VB) dedicado no SoC. Isso lhe dá um bloco contíguo de memória física.

A NPU funciona melhor com esse tipo de memória. Para acesso ideal aos dados, a NPU usaMemória estoura-A. Esse método requer que os dados estejam em um único bloco ininterrupto. Usando uma função comoHI_MPI_VB_GetBlockDa biblioteca MPP HiSilicon garante que seus dados estejam perfeitamente alinhados para o NPU. Essa técnica é fundamental para criar um aplicativo de chip AI móvel rápido e estável que ofereça desempenho consistente e de baixa potência.

VINCULAÇÃO DA PIPELINE NO CÓDIGO:

O passo final é criar a conexão de dados físicos no SoC. Você está dizendo ao SoC móvel para enviar a saída do ISP diretamente para a entrada do NPU. Essa "vinculação" cria o pipeline de cópia zero. Ele elimina a necessidade de a CPU copiar dados, o que economiza tempo e energia.

Você usa uma única e poderosa função para fazer essa conexão:HI_MPI_SYS_Bind-A. Esta função recebe a origem (canal ISP) e o destino (NPU) como argumentos.

Aqui está o que o código parece em C/C:

// Definir a fonte dos dados (canal de saída vídeo ISP)

MPP_CHN_S stSrcChn;

StSrcChn. enModId = HI_ID_VI; // ID do módulo para entrada de vídeo

StSrcChn. s32DevId = 0; // ID do dispositivo

StSrcChn. s32ChnId = 0; // ID do canal

// Definir o destino para os dados (NPU)

MPP_CHN_S stDestChn;

StDestChn. enModId = HI_ID_NNIE; // ID do módulo do motor de inferência de rede neural

StDestChn. s32DevId = 0; // ID do dispositivo

StDestChn. s32ChnId = 0; // ID do canal

// Amarre o canal do ISP diretamente ao NPU

HI _ S32 s32Ret = HI_MPI_SYS_Bind(& stSrcChn, & stDestChn);

If (s32Ret = = HI_SUCCESS) {

// O pipeline de cópia zero agora está ativo!

// O ISP irá alimentar automaticamente o NPU.

}

Com esta chamada simples, você orquestrou o hardware no SoC móvel. O ISP agora alimenta diretamente o NPU, permitindo o máximo desempenho de inferência de IA para sua rede neural. Este é o núcleo do desenvolvimento moderno AI incorporado.

AI-AWARE Tuning ISP:

Construir o pipeline é apenas o primeiro passo. Agora você deve ajustar o ISP com seu modelo AI em mente. O ajuste tradicional do ISP faz as imagens parecerem boas ao olho humano. O ajuste com inteligência artificial, no entanto, otimiza os dados da imagem para sua rede neural. Essa mudança de pensamento é fundamental para alcançar o melhor desempenho de IASoC móvel-A.

OFLOADING PRE-PROCESSING TAREFAS:

Você pode usar o ISP para fazer mais do que apenas redimensionar imagens. Pense nisso como um pré-processador dedicado para seu aplicativo de IA. O ISP pode lidar com tarefas complexas como correção de distorção geométrica de uma lente grande angular. Isso garante que sua rede neural receba uma imagem limpa e sem distorções. O descarregamento desses trabalhos para o ISP libera recursos da CPU e cria um sistema mais eficiente para o seu dispositivo de borda.

OTIMIZAÇÃO PARA A PRECISÃO AI:

Uma imagem que parece perfeita para você pode confundir seu modelo AI. Configurações que melhoram a visão humana às vezes podem prejudicar a visão mecânica. Por exemplo, a redução agressiva do ruído pode remover detalhes importantes que o modelo precisa para uma inferência precisa.

Estudos mostram que alterar as configurações do ISP de uma configuração padrão pode diminuir o desempenho da detecção-A. A chave é encontrar o equilíbrio certo para sua tarefa específica de IA.

- Diferentes redes neurais reagem diferentemente às mudanças do ISP. Um backbone ResNet50, por exemplo, pode ser mais sensível ao desfoque da redução de ruído.

- Você pode melhorar a robustez do modelo treinando sua IA com imagens que tenham várias configurações de ISP aplicadas.

- Há um limite para essa melhoria. Seu modelo sempre precisará de um nível mínimo de nitidez para ter um bom desempenho.

Seu objetivo é ajustar os parâmetros do ISP como contraste, saturação e denoising para maximizar a precisão da inferência, não apenas o apelo visual. Essa abordagem de co-design melhora o desempenho geral do sistema.

O AI-TO-ISP FEEDBACK LOOP:

A técnica mais avançada é criar um loop de feedback onde a IA controla diretamente o ISP. O NPU analisa um quadro e diz ao ISP como se ajustar para o próximo. Isso cria um sistema de visão inteligente e auto-corretivo no SoC. Por exemplo,Um sistema "Infinite-ISP" usa este método para fazer ajustes em tempo real-A.

- Auto equilíbrio branco (AWB): O NPU pode ajudar o ISP a ignorar áreas superexpostas para calcular um balanço de branco mais preciso.

- Exposição Automática (AE): O AI pode analisar o histograma da imagem e dizer ao ISP para ajustar o ganho digital, corrigindo o brilho para uma melhor análise.

Esse laço apertado entre o NPU e o ISP garante que a câmera esteja sempre capturando os melhores dados possíveis para sua IA.

MODELO NPU OTIMIZAÇÃO:

Seu pipeline de dados foi criado. Agora você deve otimizar seu modelo AI para a Unidade de Processamento Neural. Um modelo treinado em um servidor poderoso não será executado eficientemente em umDispositivo borda de baixa potênciaSem mudanças. Você precisa tornar seu modelo menor e mais rápido para obter o melhor desempenho do SoC móvel. Esse processo envolve quantização, uso dos operadores certos e testes cuidadosos.

INT8 MODELO DE QUANTIZAÇÃO:

Você pode acelerar drasticamente seu modelo alterando o tipo de dados. A maioria das redes neurais profundas é treinada usando números de ponto flutuante de 32 bits (FP32). Quantização é o processo de converter seu modelo para usar inteiros de 8 bits (INT8). EsteTorna seu modelo quatro vezes menor e aumenta significativamente a velocidade de inferência-A. Isso é essencial para exigir cargas de trabalho de IA no SoC.

Um teste AI benchmark mostra um salto enorme desempenho.Um modelo rodando a 12 quadros por segundo com FP32 pode atingir 30 quadros por segundo com INT8-A.

| Precisão | FPS (Quadros Por Segundo) |

|---|---|

| QP32 | 12 |

| INT8 | 30 |

Você pode usarFerramentas como o conversor TensorFlow LitePara realizar essa otimização. A ferramenta analisa seu modelo e o converte para o formato INT8, preparando-o para o NPU.

# Este exemplo mostra como converter um modelo para INT8

Importar tensorflow como tf

Converter = tf.lite.TFLiteConverter.from_saved_model(saved_model_dir)

Converter. optimizations = [tf.lite.Optimize.DEFAULT]

#... Outras configurações para impor a quantização INT8

Tflite_quant_model = converter.convert()

USANDO NPU-FRIENDLY OPERADORES:

O NPU é um processador especializado. Ele é projetado para acelerar operações matemáticas específicas usadas em redes neurais. Para alcançar o máximo desempenho, seu modelo de IA deve usar esses operadores "compatíveis com NPU".

Arquitetura npu Da Vinci da HiSiliconFornece aceleração do hardware para operações principais, incluindo:

- Convolução

- Agrupamento

- Ativação

- Link completo

Se o seu modelo usa operadores que não estão nesta lista, eles serão executados na CPU mais lenta. Isso cria um gargalo. Você deve modificar sua rede neural para substituir operadores não suportados por operadores acelerados por hardware. Por exemplo, você pode usar técnicas comoFusão do operadorPara combinar várias operações simples em um único, NPU-friendly um.

PERFILIZAÇÃO E DEBUGING:

A otimização não é um passo único. Você deve testar e verificar suas alterações. Ferramentas de perfil ajudam você a analisar o desempenho do seu modelo no hardware. Eles mostram exatamente quanto tempo cada camada do seu modelo leva para ser executada durante a inferência.

Usando uma ferramenta de benchmark AI, você pode identificar quais camadas estão em execução no NPU e quais estão voltando para a CPU. Esta informação é crítica. Ele ajuda você a encontrar gargalos e confirmar se a quantização e as alterações do operador foram bem-sucedidas. Esta verificação final garante que você está obtendo o melhor desempenho AI possível para sua aplicação edge.

O FUTURO DA ISP-NPU FUSÃO:

O vínculo estreito entre o ISP e a NPU é apenas o começo. Você está testemunhando uma revolução na forma como os sistemas de visão computacional são projetados. O futuro aponta para uma fusão completa desses componentes, criando sistemas de IA de câmera mais inteligentes, rápidos e eficientes. Esta evolução segue chaveAi chips tecnologia tendênciasQue irá redefinir o que é possível no limite.

INTEGRAÇÃO DE HARDWARE MAIS TIGHTER:

Designers de chips estão movendo fisicamente o ISP e a Unidade de Processamento Neural juntos no SoC móvel. Esta integração mais apertada no silicone encurta o trajecto do curso dos dados. O resultado é um aumento significativo no desempenho e redução no uso de energia. Isso torna todo o SoC baseado em ARM mais eficiente. Você obtém inferência mais rápida com menos consumo de bateria, um objetivo crítico para todos os aplicativos móveis e de baixa potência. Essa integração é um passo fundamental para a próxima geraçãoChips de inferência de baixa potência-A.

ISP PIPELINES:

O próximo grande salto é um pipeline ISP impulsionado inteiramente pela IA. Em vez de você ajustar o ISP, uma rede neural fará isso automaticamente. A IA ajustará os parâmetros da imagem em tempo real para capturar os melhores dados para uma tarefa de visão específica. Pesquisas recentes mostram que isso já está acontecendo.

Projetos pioneiros demonstram este conceito:

- ParamISPUsa um módulo neural para controlar as funções do ISP com base nas configurações da câmera, como exposição e sensibilidade.

- AdaptivoISPUsa o aprendizado por reforço para criar o melhor pipeline ISP para detecção de objetos, aumentando o desempenho.

CASOS DE USO DE BORDA EMERGENTE:

Essa poderosa fusão desbloqueia uma nova onda de aplicativos para dispositivos AI Edge. Seus produtos futuros terão capacidades de visão que parecem ficção científica hoje. As câmeras domésticas inteligentes não apenas detectarão movimento; elas entenderão o contexto e a identidade com uma precisão incrível. No setor automotivo, os carros perceberão as condições da estrada com maior clareza, tornando a condução mais segura. Esses sistemas de baixa potência trarão a IA avançada da nuvem diretamente para a borda, permitindo uma tomada de decisões poderosa e em tempo real em todos os lugares.

Agora você tem as chaves para o melhor desempenho. Você cria um pipeline de cópia zero no soc móvel, ajusta o ISP para sua rede neural e otimiza seu modelo para a npu.

Dominar esta sinergia no soc móvel desbloqueia os melhores resultados ai câmera.

O futuro da borda é um soc totalmente AI-driven. Você deve abraçar este novo design para o seu próximo projeto AI neural.

FAQ

Por que um pipeline de cópia zero é tão importante?

Você precisa de um pipeline de cópia zero para velocidade e eficiência. Ele impede que a CPU copie dados entre o ISP e a NPU. Este link de hardware direto economiza energia e faz com que seu aplicativo AI seja executado muito mais rápido no dispositivo de borda.

Preciso de um chip especial para isso?

Sim, você obtém os melhores resultados com um SoC móvel específico. Você deve escolher um chip com um poderoso NPU e um ISP que você pode ligar juntos.Chips HiSiliconSão um grande exemplo para esta tarefa.

O que é quantização INT8?

A quantização torna seu modelo AI menor e mais rápido. Você altera a matemática do modelo de números complexos de 32 bits para inteiros simples de 8 bits.

Esta simples mudança pode fazer o seu modelo funcionar duas vezes mais rápido no NPU!

Este processo é difícil de aprender?

Parece complexo no início. No entanto, os principais passos são simples. Você usa funções API específicas comoHI_MPI_SYS_Bind-A. As ferramentas dos fabricantes de chips ajudam você a construir seu pipeline passo a passo. Você pode dominar esse processo.