エッジ推論TCO分析は910対主要なライバルを増加させます

エッジAIハードウェア市場は急速に成長しています。予測によると、2030年までに589.9億米ドルに達する可能性があります。この成長ドライブ

エッジAIハードウェア市場は急速に成長しています。予測はそれが達する可能性があることを示しています2030年までに589億米ドルを使用します。この成長は競争を促進します。開発者向けに、いくつかの強力なAscend 310/910の代替手段が存在します。それぞれが特定のタスクに対して独自の利点を提供します。

主要なAscend 310/910の選択肢は次のとおりです。

- NVIDIA Jetsonシリーズ: 複雑なAIモデルの生のパフォーマンスをリードします。

- GoogleコーラルエッジTPU: このプラットフォームは、大量の低電力ジョブのTCOに優れています。

- クアルコムAIエンジン: ワットあたりの優れたパフォーマンスのためのトップチョイスです。

重要なポイント

- さまざまなエッジAIハードウェアがさまざまなニーズに適合します。NVIDIA Jetsonは高性能を提供します。Google Coralは、低コストで低電力のタスクに最適です。Qualcomm AI Engineは、モバイルデバイスのパワーとパフォーマンスのバランスを取ります。Ascend 310/910は、パフォーマンスとコスト削減の良い組み合わせを提供します。

- 総所有コスト (TCO) には、ハードウェアコスト、電力使用、およびメンテナンスが含まれます。最速のソリューションだけでなく、最良の長期ソリューションを選択するのに役立ちます。

- Google Coralは、シンプルで大量のタスクのTCOが最も低くなっています。NVIDIA Jetsonは最高のTCOを持っていますが、最高のパフォーマンスを提供します。Ascend 310/910は、パフォーマンスとTCOのバランスをうまく取ります。

- エッジコンピューティングは、クラウドソリューションに比べてコストを節約します。データをローカルで処理します。これにより、データ転送コストが削減され、応答時間が短縮されます。

ベンチマークの上昇310/910代替案

右端のハードウェアを選択するには、パフォーマンスデータを深く掘り下げる必要があります。単純なスペックシートは全体の話をしません。このセクションでは、Ascend 310/910の主要な代替案をベンチマークします。さまざまなAIモデルとワークロードのパフォーマンスを分析します。目標は、特定のプロジェクトのニーズに合わせて、明確なデータ主導の洞察を提供することです。

テスト方法とメートル

公正な比較には、標準化されたテスト環境が必要です。私たちの分析では、業界で認められているモデル、フレームワーク、およびメトリックを使用しています。このアプローチは、結果が信頼性と関連性の両方を保証します。

テスト済みのAIモデル🧪

共通のエッジAIタスクを表すモデルを選択しました。これらは、画像の分類からオブジェクトの検出、言語処理にまで及びます。

- 画像の分類: ResNet-50

- オブジェクト検出: YOLOv5、YOLOv8 (ナノ、スモール) 、SSD MobileNet V1

- 言語モデル: DeepSeek (ハイエンドエッジデバイス用)

DeepSeekなどのモデルのベンチマークは、クエリレイテンシとスループットを測定しますを使用します。これらのメトリックは、要求の厳しいワークロードのパフォーマンスを比較するために不可欠です。

ソフトウェアと精度⚙️

ソフトウェアフレームワークとデータ精度は、パフォーマンスに直接影響します。実用的な結果を得るために一般的なツールを使用しました。

- フレームワーク: 利用したテストONNXランタイムとTensorFlow Liteを使用します。これらのフレームワークは、クロスプラットフォームの互換性と最適化機能で人気があります。

- 精度: 私達はINT8およびFP16精密に焦点を合わせた。これらの設定は、速度と精度のバランスを提供します。TensorFlowLiteやONNXRuntimeなどのフレームワークは、このタイプの量子化を強力にサポートします。

注:INT8 (8ビット整数) 量子化は、推論を大幅に高速化し、モデルサイズを縮小します。リソースが制约されたエッジデバイスに最适です。FP16 (16ビット浮動小数点) は、完全なFP32よりも少ない計算コストで、INT8よりも優れた精度を提供します。

VSです。NVIDIA JETSONシリーズ

NVIDIAのJetsonシリーズは、複雑なAIのトップパフォーマーです。たとえば、Jetson AGX Orinは、大規模なビジョンモデルや、エッジでの一部の言語モデルの実行に優れています。生のパフォーマンスが主な目標である場合、JetsonはAscend 310/910の代替品の中から強力な選択肢です。

ただし、このパフォーマンスにはコストがかかります。ハイエンドのJetsonモジュールは、より多くの電力を消費します。この傾向は、AscendアーキテクチャをNVIDIAのデータセンターGPUと比較するとわかります。NVIDIA H100はパフォーマンスの上限を表していますが、そのパワーニーズはかなりのものです。Ascend 910Cは、生のパフォーマンスが低くなりますが、より電力効率の高いプロファイルを提供します。

| 仕様 | Huawei Ascend 910C | NVIDIA H100 (SXM5) |

|---|---|---|

| パワー消費量 (TDP) | 〜310W | 700Wまで |

このパワードローの違いは重要です。TDPが低いということは、Ascend 910Cがより優れた電力効率で強力なパフォーマンスを提供できることを意味します。これは、大規模な展開で運用コストを削減するための重要な利点です。

VSです。GOOGLE CORALエッジTPU

GoogleのCoral Edge TPUは、別のニッチを切り分けています。それは特定のタスクの効率のチャンピオンです。Coral TPUは、特にINT8量子化でTensorFlow Liteモデルを加速するように設計されています。競合他社が使用する電力のほんの一部で、MobileNetなどのモデルに優れたパフォーマンスを提供します。

パワーが制限され、タスクが明確に定義されている大量展開の場合、コーラルは優れた選択肢です。JetsonやハイエンドのAscendが可能な複雑なモデルを処理できない場合があります。ただし、単純なオブジェクト検出やキーワードスポッティングなどの従来のエッジAIタスクでは、消費電力が少なく、コストが低いため、TCOの主要な候補となっています。これにより、スケールアウトされたプロジェクトで最も費用効果の高いAscend 310/910の代替品の1つになります。

VSです。QUALCOMM AIエンジン

クアルコムAIエンジンは、ワットあたりのパフォーマンスに重点を置いています。Snapdragonチップセットに統合されており、モバイルおよび電力に敏感なデバイスのリーダーになっています。このプラットフォームは、パフォーマンスとバッテリー寿命のバランスが不可欠なシナリオで輝いています。CPU、GPU、および専用AIハードウェアの緊密な統合により、モデルを非常に効率的に実行できます。

クアルコムの利点は、多くのモバイルファーストアプリケーションで明らかです。

- デバイス上のLLM: クラウドに依存することなく、電子メールやリアルタイム翻訳を作成するための言語モデルを実行できます。

- カメラの特徴: AIエンジンは、リアルタイムのビデオ機能強化、背景ぼかし、高度なシーン検出を強化します。

- ゲーム: これにより、アダプティブフレームレートとリアルタイムパフォーマンスチューニングが可能になり、没入型ゲーム体験が可能になります。

バッテリー駆動デバイス用のアプリケーションを構築している開発者にとって、Qualcomm AI Engineは、利用可能な最強のAscend 310/910代替品の1つです。そのアーキテクチャは、電力制約のある環境で明確な利点を提供します。

オーナーシップ (TCO) の総コスト

パフォーマンスベンチマークは、ストーリーの一部のみを伝えます。真の評価では、総所有コスト (TCO) を考慮する必要があります。TCOには、デバイスのライフサイクル全体にわたるすべてのコストが含まれます。「どのチップが最速ですか?」から分析を移動します。「どのソリューションが最も価値を提供しますか?」に。この財務の観点は、エッジAIプロジェクトをプロトタイプから完全な展開にスケーリングするために重要です。

TCOコンポーネント

TCOを理解することは、TCOをコア部分に分解することから始まります。3つの主要なカテゴリは、エッジソリューションの総コストを定義します。

-

初期ハードウェア取得コスト (CAPEX)💰: これはハードウェアの先行価格です。これには、エッジデバイス、サーバー、および必要なマウントまたはエンクロージャーが含まれます。このハードウェアの価値はまた、期待される運用寿命を使用します。一部のデバイスは数年ごとに更新が必要ですが、他のデバイスは長持ちするように構築されています。デバイスの保証は、長期的な交換費用にも影響を与える可能性があります。

-

パワー & 冷却コスト (OPEX)⚡: エッジデバイスは24時間年中無休で電力を消費します。この運用コストは、大規模な展開全体ですぐに加算されます。エッジAIプロジェクトの電力コストを補うことができます総TCOの10-25%を使用します。このカテゴリには、高密度展開での冷却システムのコストも含まれます。データバックホール料金中央サーバーまたはクラウドに情報を送信するため。

-

开発 & メンテナンスコスト (OPEX)🛠️: このコンポーネントは、必要な人間の努力をカバーします。これには、初期のソフトウェア開発、モデルの最適化、および継続的なメンテナンスが含まれます。プラットフォームのソフトウェアエコシステムとツールの成熟度は、これらのコストに直接影響します。また、ネットワークとハードウェアを管理する従業員の費用も含まれます。

比較TCOモデル

これらの概念を具体化するために、仮想シナリオをモデル化できます。このモデルは、100個のエッジデバイスを展開するための3年間のTCOを予測しています。分析は、平均電力コストと標準的な開発努力を前提としています。コストは、プラットフォーム間の相対的な違いを示すように設計された見積もりです。

| コストコンポーネント | ステップ310/910 | NVIDIA Jetson | Googleコーラル | クアルコムAIエンジン |

|---|---|---|---|---|

| ハードウェア (CAPEX) | $120,000 | $150,000 | 6,000ドル | 75,000ドル |

| パワー & 冷却 (OPEX) | 18,000ドル | 27,000ドル | $1,500 | $4,500 |

| Dev & Maintenance (OPEX) | $40,000 | $30,000 | 25,000ドル | 35,000ドル |

| 合計3年間のTCO | $178,000 | $207,000 | 32,500ドル | $114,500 |

TCOモデルの分析

表は、特定の条件の明確な勝者を明らかにしています。

-

Googleコーラル専門的なタスクのための誰もが認めるTCOチャンピオンです。ハードウェアと電力のコストが非常に低いため、単純な量子化モデルの大量展開に最適です。コストと電力が主な制約であるプロジェクトの場合、他のプラットフォームは近づきません。

-

クアルコムAIエンジンモバイルまたはパワーに敏感なアプリケーションに最適なTCOを提供します。低電力消費と強力なハードウェア統合のバランスにより、運用コストが抑えられます。これは、効率が最も重要なバッテリー駆動のデバイスで大きなTCOの利点を提供します。

-

NVIDIA Jetsonシリーズはこのモデルで最高のTCOを持っています。高いハードウェアコストと大幅な消費電力は、最大のパフォーマンスに重点を置いていることを反映しています。このコストは、複雑なモデルの生の処理能力が最優先事項であり、予算が二次的な懸念事項であるシナリオでは正当化されます。

-

アセンド310/910説得力のある中間点を見つけます。ハイエンドの競合他社に匹敵するパフォーマンスを提供しますが、電力効率は高くなります。これにより、JetsonシリーズよりもTCOが低くなり、関連する高い運用コストなしで高性能を必要とする大規模な展開に適しています。

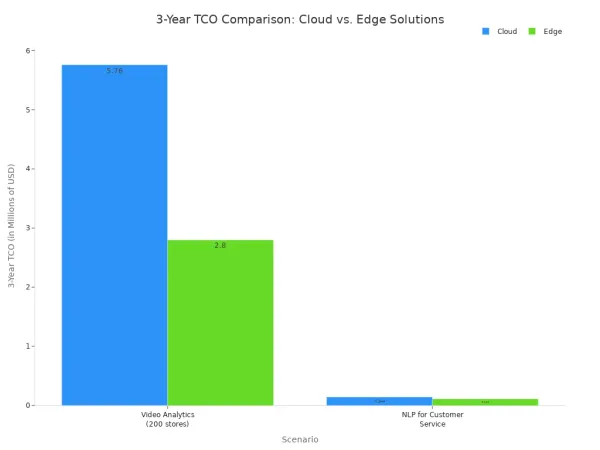

このエッジハードウェア分析は、より大きなトレンドの一部です。多くの大規模なワークロードでは、エッジコンピューティングはクラウドベースのソリューションよりも明確なTCOの利点を提供します。データをローカルで処理すると、大量のデータ転送料金が回避されます。単一の高解像度ビデオストリームは、毎月テラバイトのデータを生成する可能性があり、それをすべてクラウドに送信するには費用がかかります。エッジデバイスはオンサイトでデータを処理し、わずかな結果のみを送信するため、帯域幅コストを大幅に削減します。

下のグラフは、3年間で同じタスクでエッジソリューションのTCOがクラウドソリューションのTCOよりも大幅に低くなる可能性があることを示しています。

これらの節約を最大化するには、右端のハードウェアを選択することが重要です。各プラットフォームは、パフォーマンス、パワー、およびコストの異なるバランスを提供し、最終的なTCOに直接影響を与えます。

右端のハードウェアを選択することは、プロジェクトのニーズに依存します。アプリケーションタイプ、電力制限、およびコストパフォーマンスの目標が最良の選択を導きますを使用します。GPUは、リアルタイムAIタスクのための低遅延処理を提供しますを使用します。データは、さまざまな仕事の明確な勝者を示しています。

クイック推奨🏆

- NVIDIA Jetson: 複雑なモデルで最大のパフォーマンスを選択します。

- Googleコーラル: 大容量、低電力のタスクで最も低いTCOを選択します。

- クアルコムAIエンジン: モバイルデバイスで最高のワットあたりのパフォーマンスに使用します。

- ステップ310/910: 高性能およびより低いTCOの強いバランスのために選びなさい。

よくある質問

総所有コスト (TCO) とは何ですか?

総所有コスト (TCO) は、製品の完全なコストを測定します。それは3つの主要な部分を含みます:

- 💰初期購入価格 (CAPEX)。

- ⚡継続的な電力および冷却コスト (OPEX)。

- 🛠️ 開発および保守費 (OPEX)。

エッジAIにとってINT8精度が重要なのはなぜですか?

INT8の精度により、AIモデルはより小さく、より高速になります。これは、限られたエッジデバイスに非常に便利ですメモリそして力。これにより、強力で高価なハードウェアを必要とせずに、複雑なモデルを効率的に実行できます。このプロセスは、TCO全体を下げるのに役立つ。

複雑なAIモデルに最適なハードウェアはどれですか?

NVIDIA Jetsonシリーズは、しばしば最高の生のパフォーマンスを提供します。高度なビデオ分析やデバイス上の言語処理などのタスク用に、大規模で複雑なモデルを実行するのに優れています。パフォーマンスが主な目標であるとき、この力はそれを一番の選択にします。

エッジコンピューティングはクラウド上でどのようにお金を節約しますか?

エッジコンピューティングはデータをローカルで処理します。この操作により、大量のデータをクラウドに送信する必要がなくなります。それはデータ転送料金にかなりのお金を節約します。ローカル処理は、リアルタイムアプリケーションの応答時間も高速化します。